Фабрика фейків чи нова реальність. Розмова про штучний інтелект у медіа

Інтерв'ю

Живі мізки проти штучних: ШІ – ворог чи друг медійникам?

Штучний інтелект найближчим часом не замінить роботу журналіста повністю, запевняє «Главком» старша юристка ГО «Лабораторія цифрової безпеки» Тетяна Авдєєва. Так, на Заході є поодинокі приклади сайтів, де контент формує винятково ШІ, але це – розважальні ресурси.

Штучний інтелект поки що не впорається із таким складним жанром, як журналістське розслідування, та й загалом – йому ще не все під силу. Але навіть те, що під силу, має контролювати та перевіряти жива людина. Бо ШІ досить часто, як каже Авдєєва, «галюцинує», тобто видає зовсім не те, про що йшлося у запиті.

Так що кому-кому, а представникам мас-медіа поки зарано думати про зміну професії через появу ШІ. Про те, чим може бути корисним штучний інтелект у журналістській роботі, а чим здатен зашкодити – далі у статті.

Наскільки взагалі використання штучного інтелекту в Україні є узаконеним?

Мова, звісно, не про те, що використання ШІ є протиправним діянням. Воно просто іще неунормоване. І Україна поки робить перші кроки для того, щоб напрацювати загальну правову рамку для роботи з ШІ та привести національне законодавство у відповідність до європейського.

Восени 2024 року Мінцифри підписало декларацію щодо саморегулювання з дев’ятьма українськими ШІ-компаніями. На основі Ддекларації вони розробили Добровільний кодекс поведінки, який став інструментом саморегулювання – добровільними зобовʼязаннями, взятими на себе компаніями. Але законодавче регулювання цієї сфери матиме місце не раніше за 2027 рік. При цьому вже до 2030-го уряд хоче бачити Україну у трійці головних країн-розробників штучного інтелекту у публічному секторі.

Що стосується співпраці з партнерами, то ще у 2023 році Україна підписала декларацію Блетчлі, яка передбачає міжнародну співпрацю в дослідженнях безпеки ШІ. А також долучалась до розроблення рамкової Конвенції Ради Європи про ШІ та права людини, яку ухвалили восени.

Євросоюз вже розробив регулювання ШІ – Акт про штучний інтелект, який регулює порядок створення і використання систем ШІ. Наразі законодавці ЄС намагаються напрацювати Директиву щодо відповідальності у сфері ШІ. Але цей документ зустрічає хвилю критики, тож його прийняття гальмує відсутність політичної згоди. Тобто акт пишуть повільніше, аніж ШІ підкидає нові виклики.

Акт про ШІ забороняє користувачам робити деякі речі. Наприклад, впливати за допомогою ШІ на політичний вибір громадян. Або створювати за допомогою ШІ контент, який може зашкодити вразливим верствам населення. Також не можна використовувати фото із соціальних мереж для створення баз даних без згоди користувача тощо.

Акт також містить і перші покарання за порушення правил, які він передбачає. Компанії-порушнику загрожуватиме штраф до 35 млн євро – це максимальна санкція. Україна не має зобов’язання негайно прийняти такий акт, але як держава, що прагне до євроінтеграції, муситиме приєднатися імплементувати аналогічні вимоги у майбутньому.

Чим штучний інтелект може бути корисний журналістам?

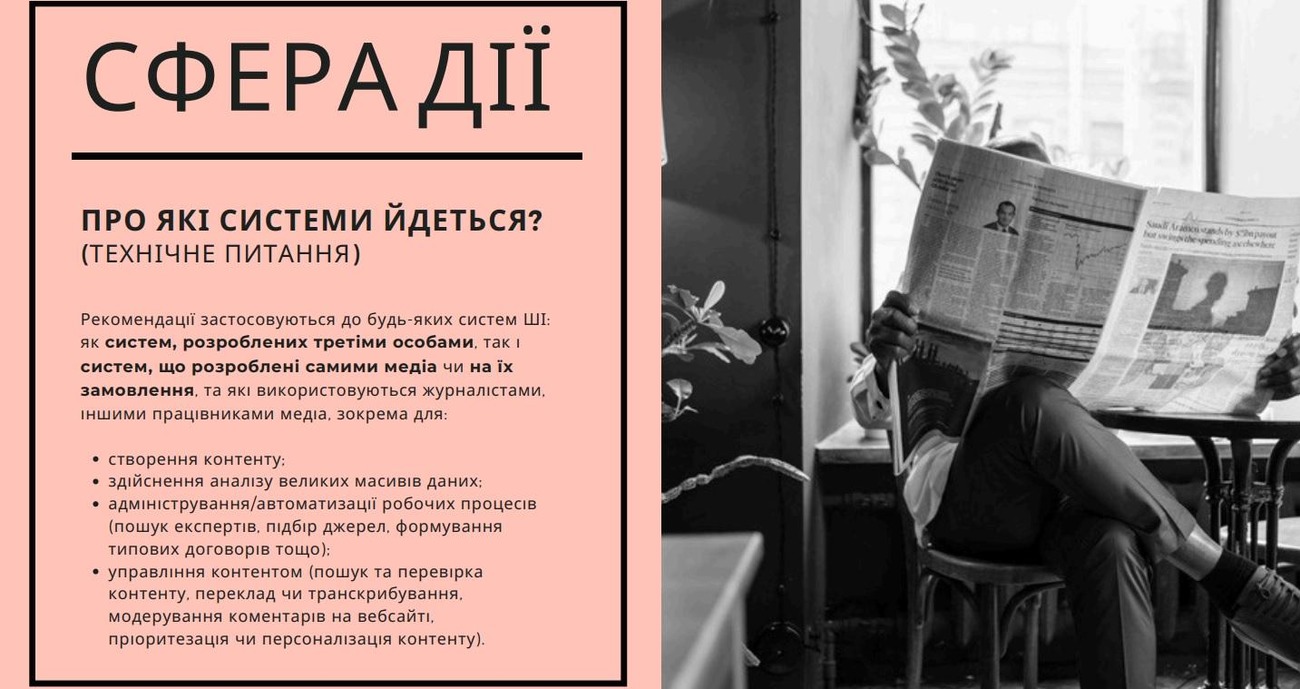

Відповідаючи на це питання, Тетяна Авдєєва ділиться слайдом, який унаочнює сферу застосування штучного інтелекту в медіа. Окрім того, що зазначено на ілюстрації – генерування контенту, пошук інформації та аналіз даних, управління контентом – вона вказує на ще деякі можливості ШІ.

Штучний інтелект може перевірити будь-який продукт на предмет його створення ШІ. Він також здатен виправляти помилки і є незамінним у навчанні – зокрема, допоможе скласти план того чи іншого навчального курсу. Нарешті, ШІ підходить для моніторингу згадок про ваші матеріали в інших медіа, він може описати враження про вашу репутацію, яке складається після такого моніторингу.

Скільки зараз українських медіа працюють зі штучним інтелектом?

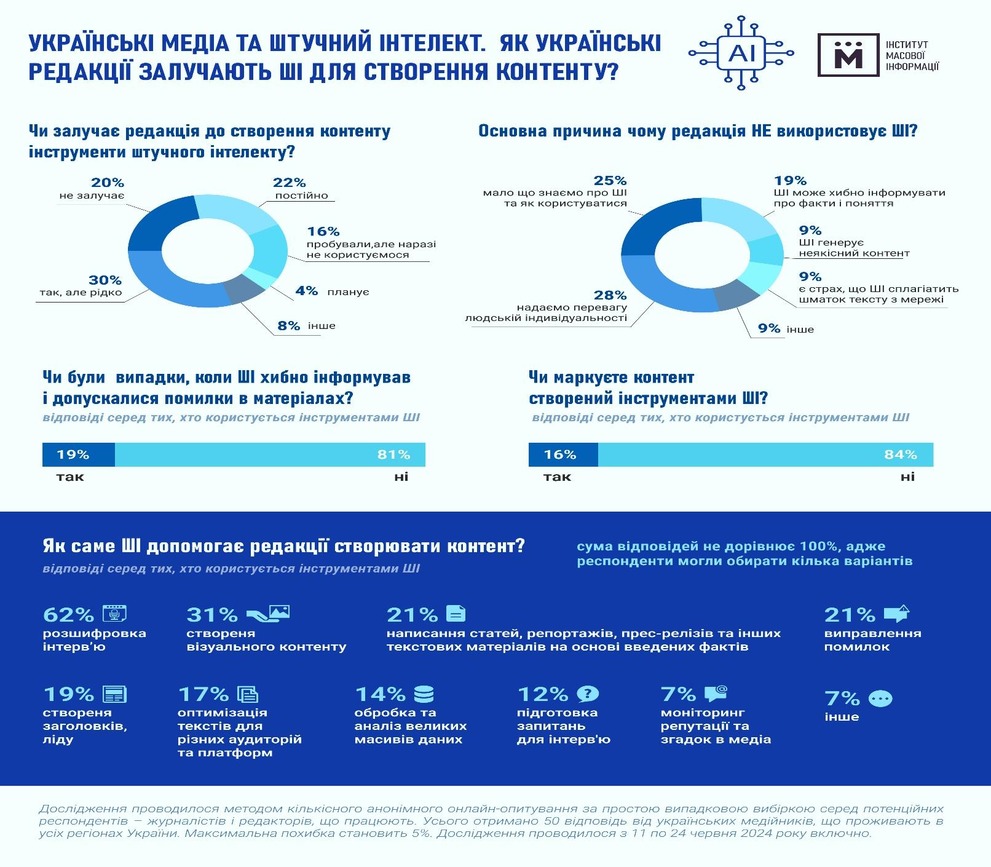

За даними опитування Інституту масової інформації, лише 22% українських медійників повідомили, що їхня редакція на постійній основі використовує хоча б один інструмент штучного інтелекту. 30% опитаних зазначили, що в їхній редакції зрідка залучають ШІ. Водночас 20% журналістів повідомили, що не використовують інструменти ШІ у своїй роботі. Крім того, 16% опитаних зазначили, що раніше користувалися інструментами ШІ, але наразі припинили.

При цьому, зазначають в ІМІ, найчастіше журналісти використовують функціонал ШІ для розшифровки інтерв'ю. Друга найбільш запитана можливість – створення візуального контенту для матеріалів. На третьому місці – платформи, що виправляють помилки.

Нарешті, штучний інтелект використовують для написання статей, для генерування заголовків та лідів, для оптимізації готових текстів. А ще – для аналізу великого масиву даних, для підготовки питань до інтерв’ю, і, нарешті, для збирання згадок у медіа.

Ті, хто відмовляється працювати з ШІ, роблять це переважно з трьох причин: вони не вміють користуватися відповідним інструментарієм; вважають, що індивідуальність автора не замінить ніщо; не довіряють якості контексту, згенерованого ШІ, оскільки у тому числі вважають, що він може бути плагіатом.

Що треба знати редакціям, які вирішать взяти на озброєння використання ШІ

Тим, хто планує використовувати ШІ у своїй журналістській роботі, Тетяна Авдєєва радить подумати, яка саме система потрібна, тобто для початку чітко сформулювати запит і оцінити потреби у ШІ.

Після цього протестувати декілька простих завдань на різних системах, які здатні виконувати їх. Визначити, яка з них найбільш продуктивна і яка здатна – що важливо! – якісно обробляти запит та видавати результат українською мовою (у разі, якщо медіа працює саме українською).

Також на першому етапі важливо чесно відповісти собі на питання, чи дійсно ШІ полегшить життя редакції, чи контроль контенту (вичитка текстів тощо) тільки ускладнить його?

Якщо вибір зроблено, необхідно подбати про навчання усіх дотичних осіб методам роботи з ШІ – цю частину процесу не можна лишати напризволяще. Власне, якщо не як окрема штатна одиниця, то, принаймні, один з членів колективу мусить взяти на себе обов’язки «головного по використанню ШІ», аби решта команди могла звернутися до нього за консультацією. Особливо актуальним це є, коли йдеться про складні системи ШІ.

А от хто точно знадобиться редакції, так це фаховий юрист – для вичитування ліцензійної угоди з розробником ШІ та розтлумачування відповідальності, яка лягає на редакцію.

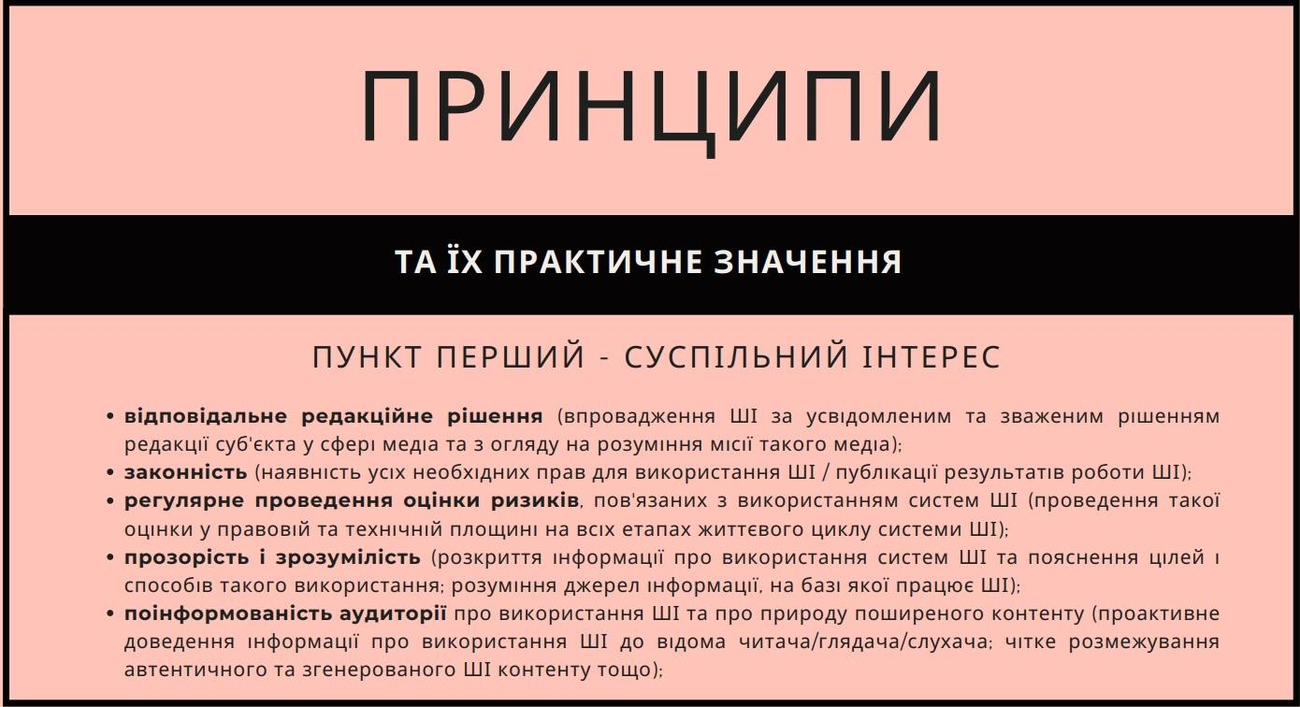

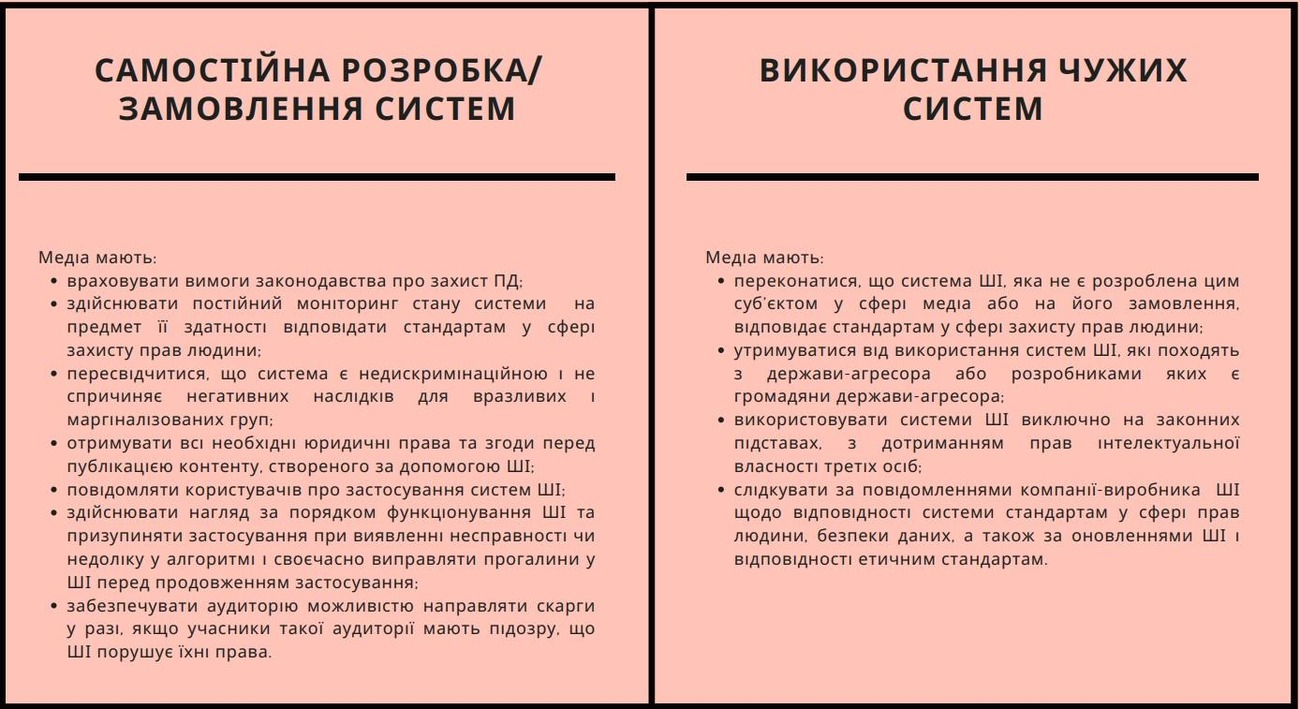

Інші рекомендації від Лабораторії цифрової безпеки та Експертно-консультативного комітету з розвитку ШІ при Мінцифрі представлені на слайдах:

Що пропонує у плані систем штучного інтелекту український виробник?

«Главком» попросив Тетяну Авдєєву скласти ТОП-5 найкращих продуктів ШІ від українського виробника. Адже часи, коли на ринку домінував переважно ChatGPT (а це була перша «натренована» «генеративка», яка вийшла на ринок у 2018-му), вже минули. Отже, рейтинг від Авдєєвої такий:

- Grammarly – система, що аналізує граматичні, пунктуаційні та стилістичні помилки. Ця платформа підлаштовується під ваш стиль письма, навчає писати чітко, зрозуміло та переконливо. При цьому Grammarly дбає не лише про коми та крапки. Вона також підказує синоніми, більш вдалі словесні конструкції тощо.

- YouScan – платформа для моніторингу й аналітики даних з соціальних медіа на основі ШІ. Відстежує позитивні та негативні згадки бренду, знаходить його прихильників та інфлюенсерів, повідомляє про нові тренди в соцмережах. Також аналізує не лише тексти, а й візуалізації.

- ZibraAI – база для створення візуальних ефектів – у тому числі для тих, хто працює у сфері геймінгу, телебачення тощо. Допомагає створювати ефекти та / або прискорює процес їх розробки. Також забезпечує новий рівень реалістичності, як наголошують виробники.

- Respeecher – унікальний продукт у галузі клонування голосу на основі ШІ. Ця технологія дає можливість говорити одній людині голосом іншої. Виробники наголошують: їх продукт передає усі нюанси та емоції людського мовлення, тож згенерований голос звучить дуже природно.

- Reface – додаток української компанії RefaceAI, який дозволяє змінювати обличчя на гіфках та відео. Унікальність застосунку e тому, що він робить фейкові зображення максимально реалістично. За словами розробників, їхня технологія заснована на штучному інтелекті, в основі якого лежить метод машинного навчання.

Додамо від «Главкома», що коли йдеться саме про український продукт, зазвичай також згадують про:

- Reply.io – першу систему для покращення продажів та залучення клієнтів на основі ШІ. Має власну базу даних з понад 140 млн контактів. Reply.io має свого власного розумного асистента на основі ChatGPT. Помічник має здатність відповідати на базові запити клієнтів, надавати додаткову інформацію, переадресовувати повідомлення та бронювати зустрічі у календарі.

А у чому може бути шкода від використання штучного інтелекту?

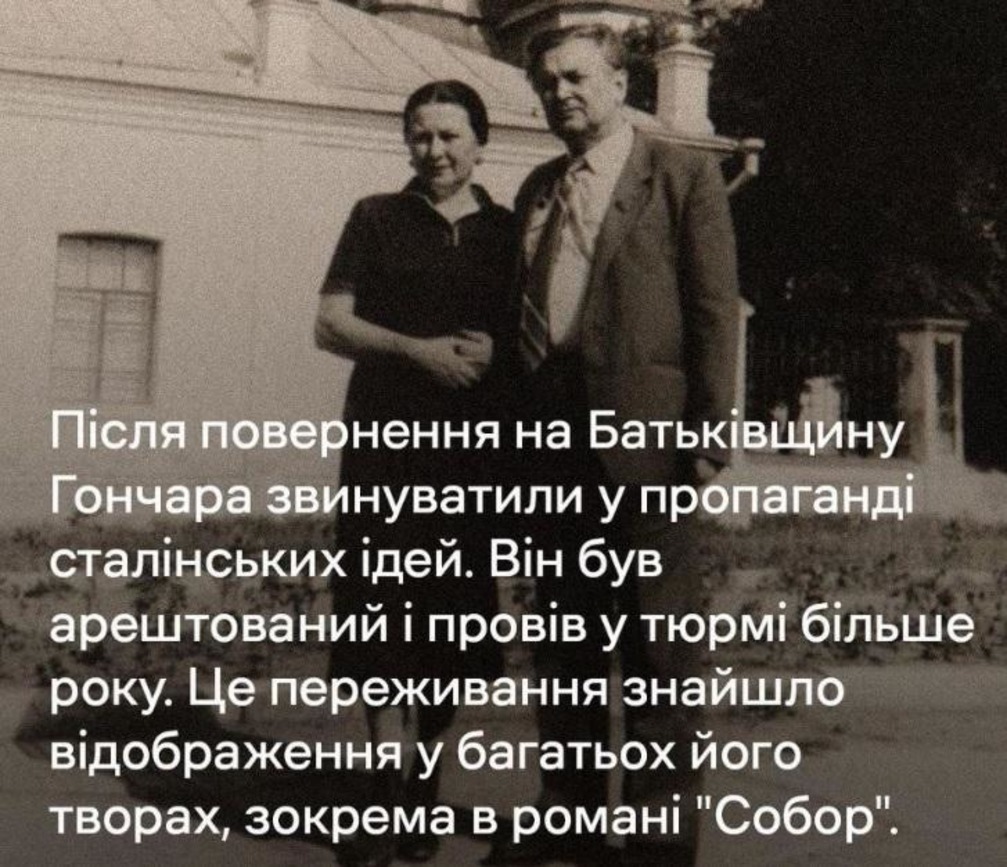

Відповідаючи на це запитання, Тетяна Авдєєва нагадує про скандал, у який потрапив «Новий канал». 3 квітня 2023 року в Instagram «Нового каналу» з’явився допис до 105 річниці з дня народження українського письменника Олеся Гончара. У тексті йшлося про «маловідомі факти» його життя, які насправді виявилися не «маловідомими», а вигаданими. А подекуди – взагалі абсурдними.

Окрім того, що у цьому дописі було переплутано все на світі – зокрема, й місце народження письменника та професія його батька – у тексті йшлося і про те, що Гончара звинуватили у пропаганді сталінських ідей, за що навіть ув’язнили. Однак у сталінські часи йому просто не могли карати за прихильність до ідей вождя. Навпаки – лояльного до влади Гончара було відзначено багатьма радянськими преміями.

Пізніше у соцмережах «Нового» підтвердили факт використання ChatGPT та вибачились за поширення неправди. Але, як наголошує Авдєєва, головна проблема з ШІ у медіа полягає у тому, що журналісти лінуються зайнятися фактчекінгом, отримавши на руки готовий продукт. А якщо не перевіряти інформацію, яку видав ШІ, вона приноситиме здебільшого лише шкоду.

«Штучний інтелект здатен до генерування дези (дезінформації – «Главком»). Тобто ШІ галюцинує, а ми не перевіряємо, – каже Авдєєва. – Ще один фактор ризику, пов'язаний з ШІ, це те, що ми не до кінця розуміємо, куди йдуть дані, які ми вводимо, тобто злив конфіденційних даних не виключений».

«Також системи ШІ (наприклад, розпізнавання облич) можуть бути використані і проти медіа: вони здатні ідентифікувати джерела, з якими працює журналіст і які не повинні бути не розкритими, а це означає завдавання репутаційної шкоди виданню. Нарешті, коли йдеться про чутливі теми (мобілізація, прильоти), використання ШІ може добити довіру до медіа. Якщо на Заході звернуть увагу на ілюстративний матеріал, зроблений ШІ, то поставлять логічне запитання: а чи не згенеровані в Україні усі зображення, пов’язані з війною?».

Авдєєва, наприклад, має на увазі картинку з хлопчиком, що плаче, яка з’явилася у мережі після 14 січня 2023 року, коли Росія вдарила по Дніпру. Ракета влучила тоді у дев’ятиповерхівку, повністю зруйнувавши два під’їзди. Внаслідок цього загинули 46 людей, і серед них – шестеро дітей.

А вже 16 січня декілька спільнот у Facebook поширили публікацію із зображенням маленького хлопчика, який плаче. Ці зображення згодом перепоширювали і українські медіа. Під «світлиною» – щемкий підпис: «Цей малюк вижив. Він назавжди запам’ятає, хто зруйнував його світ». Проте насправді малюка згенерувала нейромережа.

Як протидіяти діпфейкам у мережі?

Хто і навіщо створив цю картинку, встановлено так і не було. Чи то автор мав щирі наміри, не зважаючи при цьому на негативні наслідки, чи то він переслідував суто провокативну мету – цього ми не дізнаємося. Так само не дізнаємося і творців діпфейків за участю перших осіб держави. Приміром, такого, який був поширений у середині березня 2022 року – із президентом України Володимиром Зеленським.

Ролик, де Зеленський закликає скласти зброю, з'явився в ефірі телеканалу «Україна 24», зламаному хакерами. Одразу після зламу глава держави опублікував спростування на офіційній сторінці. А Facebook, де також була опублікована ця фальшивка, видалив запис, пояснивши, що робить це, бо переконаний: прозвучала заява, яка насправді не мала місця у реальності.

На запитання, чи можуть журналісти протидіяти діпфейкам, Авдєєва відповідає так: зробити це доволі важко.

«Щоб вийти на розробника діпфейку, можна проаналізувати, де і ким він був поширений. Але якщо діпфейк поширений за кордоном, це ускладнює завдання, а якщо у соцмережі – це потребуватиме звернення до такої платформи. Що не завжди можливо, бо, наприклад, Telegram відмовляється від подібної співпраці», – каже вона.

Втім, головне тут критичне ставлення журналістів до інформації. Вони мусять завжди перевіряти та переперевіряти, тим паче, якщо йдеться про фейки щодо держави – зробити це за наявності сайтів державних органів влади не складно. Крім обов’язкової верифікації джерела, існує і must do для сумлінних виробників відеопродукції, згенерованої ШІ: вони зобов’язані маркувати її відповідним чином.

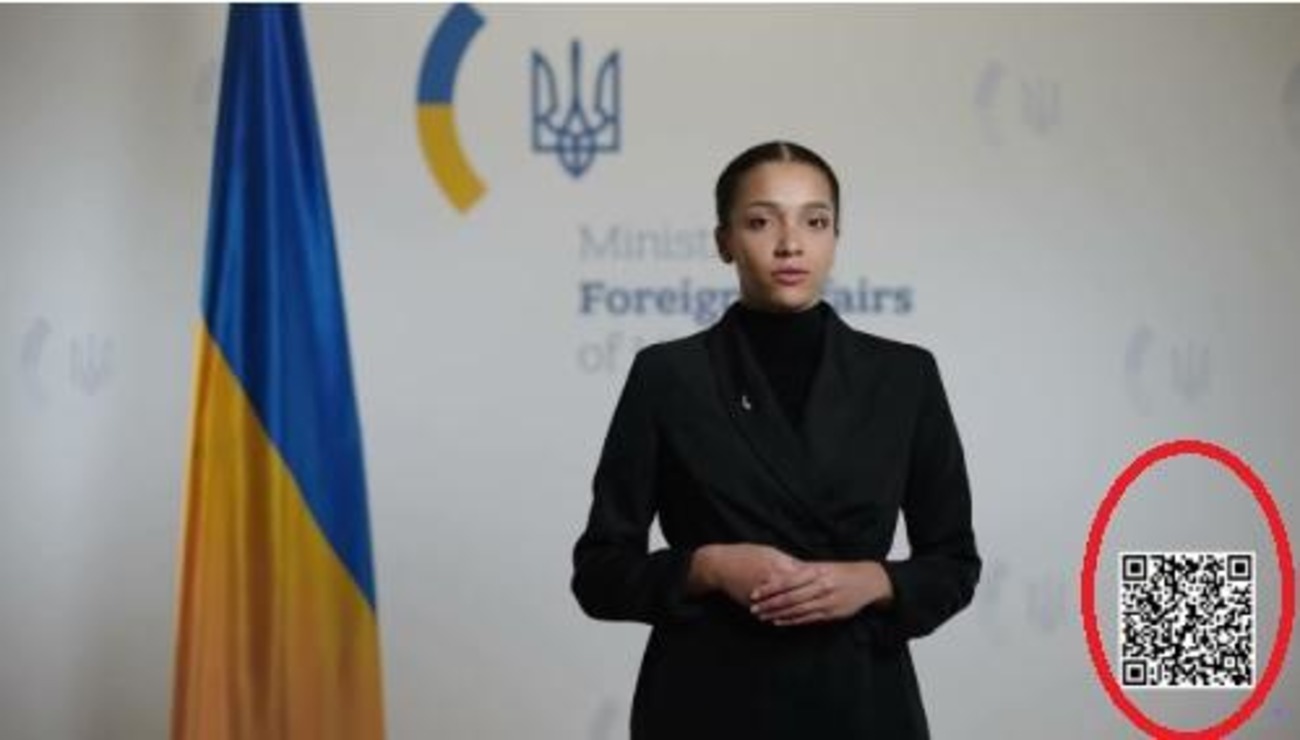

Як приклад подібної добросовісної роботи Авдєєва наводить нещодавно створеного аватара українського МЗС – Вікторію ШІ. «Цифрова особа» Вікторія консультує українців з консульських питань, і якщо це дійсно офіційне відео МЗС, воно завжди містить QR-код. За такою ознакою не складно відрізнити оригінальну продукцію від підробки.

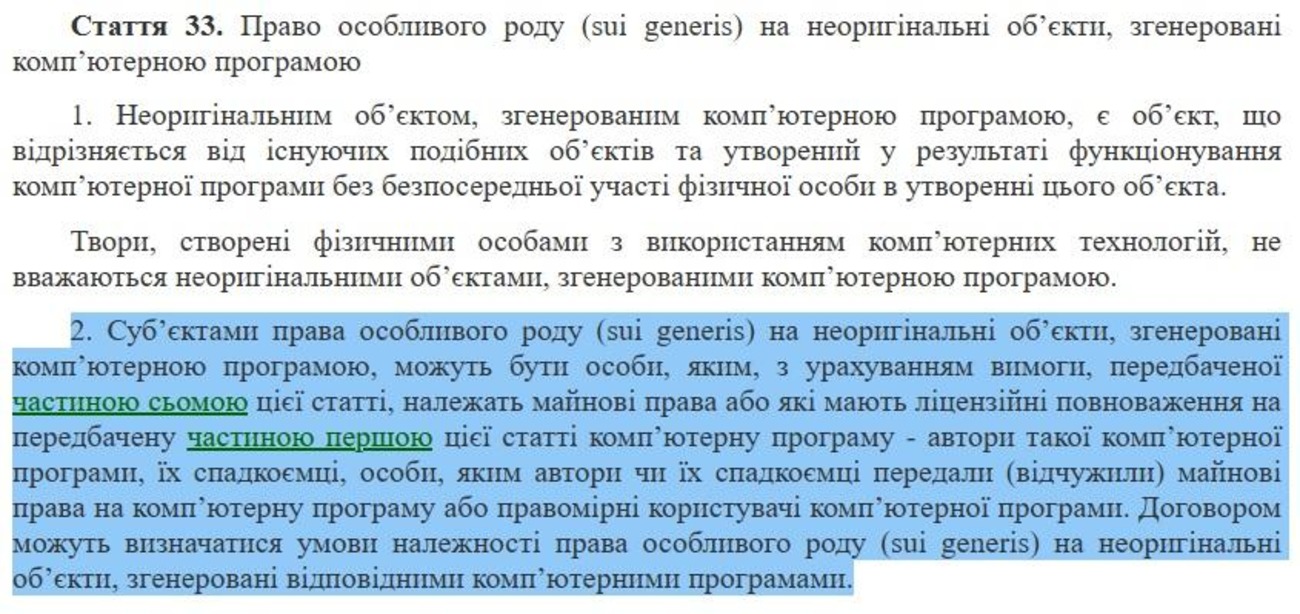

Кому належать права на згенероване зображення?

Припустимо, що журналіст за допомогою ШІ створив унікальне зображення – кому воно належить, авторові чи платформі, на якій його згенеровано? «Залежно від системи, – відповідає Тетяна Авдєєва. – Якщо це український продукт, то, відповідно до статті 33 закону про авторське право, у такого контенту немає конкретного автора, але є суб’єкт, який може розпоряджатися так званими «правами особливого роду». І у більшості випадків таким суб’єктом буде саме автор малюнка».

«Інше питання, – додає Авдєєва, – що написано у ліцензійній угоді іноземної системи, яку ви використовуєте. Midjourney, наприклад, зберігає за собою право інтелектуальної власності. І про це у ліцензійній угоді якраз і зазначено».

Чи може журналіст запобігти копіюванню штучним інтелектом його стилю?

А чи може медійник, який вважає свій стиль унікальним та таким, на якому базується його власний бренд, запобігти відтворенню цього стилю за допомогою систем ШІ?

«Річ у тім, – відповідає Авдєєва, – що поки відсутнє регулювання того, які дані можуть бути використані для навчання систем штучного інтелекту. Якщо йдеться лише про копіпаст без посилання на джерело, то це нескладно виявити. Складніше, коли система навчається на ваших матеріалах, а потім використовує ваш художній стиль».

Експертка приводить за приклад дуже впізнаваний стиль Сергія Жадана – його, так би мовити, візитівку. Стало можливим, каже вона, попросити ШІ писати вірші у цьому стилі і потім поширювати їх у мережі.

Чи позиватиметься Жадан до розробників систем, які використовують поетичні махінатори, невідомо. Натомість американський письменник-фантаст Джордж Мартін, автор «Гри престолів», вже зараз позивається до OpenAI, бо не хоче, аби його книжки чи сценарії використовувалися системою.

«Поки що результатів такого позову немає, – каже Авдєєва, але загалом буде цікаво подивитися, куди рухається практика правозастосування. Бо за законодавством, ідеї, концепції чи методи для створення будь-чого не захищені авторським правом. Тобто стилістика Мартіна чи Жадана законодавчо не захищені, захищений тільки кінцевий продукт – підписаний ними твір».

Чи забороняє ШІ «мову ненависті»?

Насамкінець «Главком» поцікавився явищем, яке у деяких соцмережах, наприклад, у Facebook, носить назву «мова ворожнечі» і може стати приводом для блокування опублікованого контенту. Чи може ШІ перешкодити створенню зображення або відео, якщо воно, на думку штучного інтелекту, має такі ознаки?

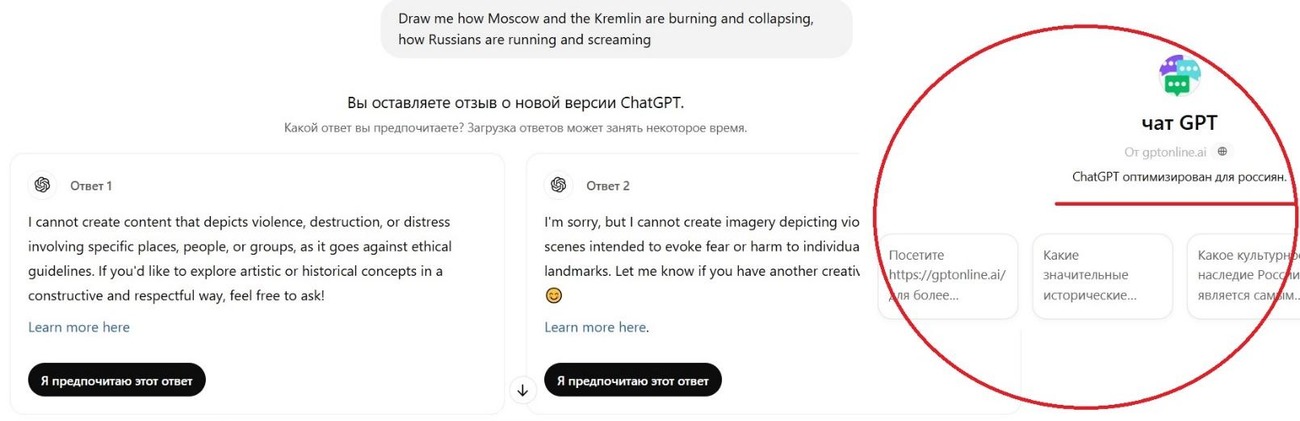

«Все знову таки залежить від платформи. Той таки ChatGPT має обмеження на порнографічні, суїцидальні тематики та на мову ворожнечі. Деякі платформи мають обмеження на обробку персональних даних – Google Cloud Platform, наприклад, не стане складати профайл на основі ваших соцмереж, бо він не має права на обробку персональних даних. Тобто певні вбудовані обмеження вже існують в системах. Хоча контекстуально все залежатиме від того, які параметри визначення «мови ворожнечі» закладено у систему», – говорить Тетяна Авдєєва.

Але, додає вона, якщо ви попросите ШІ створити, приміром, картинку «Кремль у вогні», існує вірогідність, що це не буде сприйнято як «мова ворожнечі». Бо найчастіше «мовою» ворожнечі» вважають пряму дискримінацію конкретної особи.

Ми вирішили перевірити слова Тетяни Авдєєвої та попросили ChatGPT намалювати, як руйнується та горить Москва і Кремль. ChatGPT радісно повідомив, що тепер він «оптимізований для росіян» (що б це не означало) та запропонував ознайомитися з «культурним спадком Росії». А по суті завдання відповів, що не може створювати картини насильства.

Отже, ми залишилися без візуалізації заповітного бажання українців, але зі сподіванням, що воно таки здійсниться навіть без участі штучного інтелекту. Зрештою, реальність та ШІ – це площини, які мають точки дотику, але не ідентичні одне одному. І це прекрасно.

Наталія Лебідь, «Главком»

Читайте також:

- Що залишиться людям, коли Штучний Інтелект забере у них роботу?

- Інтелектуальна революція. Що провіщає людству ChatGPT

- Чи існує Бог і хто створив Всесвіт? Інтерв’ю зі штучним інтелектом ChatGPT

- ChatGPT поширює російські фейки – звіт NewsGuard

- Журнал Тime уклав угоду зі штучним інтелектом

- У Євросоюзі запрацював закон про штучний інтелект

- Найближчим часом людство зіткнеться з надрозумом: творець ChatGPT зробив заяву

Коментарі — 0